Praktikum Forschungsprojekt: Anthropomatik praktisch erfahren

- Typ: Praktikum (P)

- Semester: WS 19/20

-

Dozent:

Prof. Dr.-Ing. Uwe Hanebeck

Ajit Basarur - SWS: 4

- LVNr.: 24281

Praktikum Forschungsprojekt: Anthropomatik praktisch erfahren

Das Ziel des Praktikums Forschungsprojekt: Anthropomatik praktisch erfahren ist es, Studenten die Möglichkeit zu geben, in aktuelle Forschungsgebiete hineinzuschnuppern. Dabei sollen in Gruppen von jeweils zwei bis drei Studenten Soft- und/oder Hardware-Projekte erstellt werden. Die zu bearbeitenden Aufgaben kommen aus den Forschungsbereichen verteilte Messsysteme, Robotik, Mensch-Roboter-Kooperation, Telepräsenz- und Assistenzsysteme. Das Praktikum gibt interessierten Studenten die Möglichkeit, Erfahrungen sowohl im wissenschaftlichen Arbeiten als auch im Projektmanagement zu sammeln.

In dem Praktikum können folgende Fähigkeiten erlernt und vertieft werden:

- Umsetzung von theoretischen Methoden in reale Systeme

- Erstellung von technischen Spezifikationen

- Projekt- und Zeitmanagement

- Entwicklung von Lösungsstrategien im Team

- Präsentation von Zwischen- und Endergebnissen (in Poster- und Folienvorträgen sowie einem Abschlussbericht)

Das Praktikum (4 SWS) besteht aus 2 Lehrveranstaltungen: einem praktischen Teil (mit 2 SWS), welcher die konkrete Implementierung der Aufgabenstellung des Praktikums durch die Studenten beinhaltet, und einem theoretischen Teil (mit 2 SWS). In diesem Teil des Praktikums vermitteln die wissenschaftlichen Mitarbeiter den Studenten die Theorie für das jeweilige Projekt. Außerdem diskutieren die Mitarbeiter mit den Studenten in persönlichen Gesprächen mögliche Lösungen zu Problemen, die bei der Implementierung auftreten. Beide Teile sind nur in Kombination belegbar.

Am Tag der Informatik 2010, 2015 und 2016 wurde das Praktikum Forschungsprojekt "Anthropomatik praktisch erfahren" als bestbeurteiltes Praktikum ausgezeichnet.

Weitere Informationen zum Praktikum Forschungsprojekt: Anthropomatik praktisch erfahren.

Themengebiete

| Projekt | Thema | Betreuer |

|---|---|---|

| 1 |

Ausschleusung von Schüttgutteilchen mit mechanischen Fingern |

Florian Pfaff, Benjamin Noack, Marcel Reith-Braun |

| 2 |

Erweiterung von Lokalisierung und Lageregelung eines mobilen omnidirektionalen Roboters |

Florian Rosenthal, Ajit Basarur |

| 3 |

Susanne Radtke, Christopher Funk |

|

| 4 |

Entwurf einer neuartigen Regelung mittels Reinforcement Learning (RL) |

Johannes Westermann, Ajit Basarur |

| 5 | ||

| 6 |

Identifikation und Signalverarbeitung für Indoor-Lokalisierung |

Christopher Funk, Susanne Radtke |

| 7 | ||

| 8 |

WLAN-basierte Regelung und Lokalisierung zur Pfadplanung einer mobilen Roboterplattform |

Benjamin Noack, Florian Rosenthal |

| 9 | RGB-D Inertial 3D Mapping* | Kailai Li |

| 10 | Multi-modality Map Fusion* | Kailai Li |

* = wird auf Englisch gehalten!

Projekt 1

Einleitung

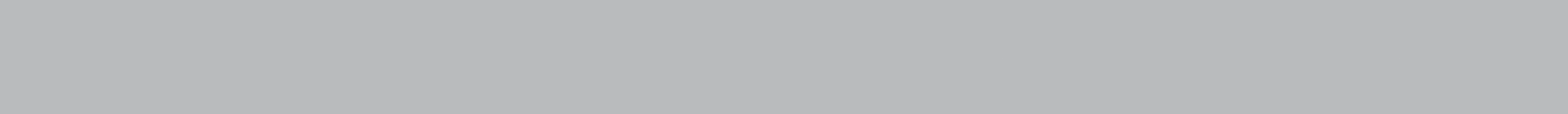

Bei sogenannten optischen Sortierern werden Teilchen auf Basis visueller Eigenschaften klassifiziert. Bei der Anlage, so wie sie vom Fraunhofer IOSB lizenziert wird, werden durch richtiges Timing und gezieltes Aktivieren von Druckluftdüsen eine Klasse der Teilchen „ausgeblasen“, um so die beiden Klassen voneinander zu trennen.

Aktuell wird am ISAS ein kleiner Sortierer in Form eines Rutschensortierers aufgebaut. Im Rahmen dieses Praktikums soll sein neuer Ansatz zur Separation erprobt werden. Hierbei sollen eine Art von "mechanischen Fingern" umgesetzt werden. Es sollen also harte Objekte in den Flugpfad der Teilchen bewegt werden, die dann bestimmte Teilchen ablenken. Da nur bestimmte Teilchen (und nicht alle) abgelenkt werden sollen, müssen schnelle Reaktionszeiten erreicht werden.

Diese Ausschreibung ist besonders für interdisziplinäre Teams, die auch Studierende des Maschinenbaus beinhalten, geeignet.

Aufgaben

- Recherche zu Möglichkeiten zur mechanischen Ablenkung von Partikeln

- Planung einer Hardwareumsetzung inklusive Festlegung der Bauteile

- Umsetzung in Hardware

- Umsetzung einer einfachen Möglichkeit zur Ansteuerung

Projekt 2

Einleitung

bitte hier klicken.

Am ISAS wird zurzeit ein mobiler Roboter entworfen, welcher über vier unabhängig angetriebene Radeinheiten verfügt, die eine omindirektionale Bewegung ermöglichen. Damit sich der Roboter zielgerichtet bewegen kann (z.B. einen bestimmten Punkt anfahren oder einem gegebenen Pfad folgen), muss er schritthaltend seine Lage (Position+Orientierung) bestimmen und ggf. anpassen.

In Rahmen dieses Praktikums sollen die bestehenden Verfahren zur Lokalisierung und Lageregelung erweitert werden.

Dazu soll zum einen eine Koppelnavigation auf Basis der Daten von magnetischen Resolvern (diese liefern die Position der Motorwellen) in die Lokalisierung integriert werden. Zum anderen soll die bestehende Lageregelung um ein flachheitsbasieren Verfahren zur Folgereglung ergänzt werden.

Aufgaben

- Einarbeitung in das existierende System (Hardware und Software),

- Implementierung eines Verfahrens zur Bestimmung der Radgeschwindigkeiten aus den Daten der Resolver,

- Integration einer verbesserten Koppelnavigation in die Lokalisierung,

- Implementierung eines flachheitsbasierten Ansatzes für die Lageregelung

- Untersuchung der Performance der eingesetzten Verfahren für einfache Trajektorien wie Kreis oder Quadrat.

Projekt 3

Einleitung

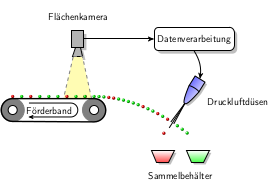

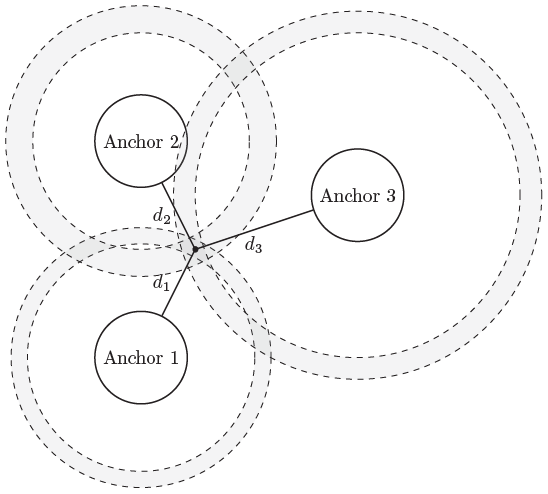

Die Lokalisierung innerhalb von Gebäuden ist in vielen Bereichen, z.B. in der Robotik, eine kritische Aufgabe und benötigt häufig eine hohe Genauigkeit. Im industriellen Bereich haben sich in letzter Zeit Technologien basierend auf Ultrabreitband (UWB) durchgesetzt. Obwohl UWB weniger anfällig für Mehrwegeausbreitung und Interferenzen ist, kann das Signal durch metallische Gegenstände verzerrt werden und somit zu schlechteren Lokalisierungsergebnissen führen.

In einigen Anwendungen werden nicht einzelne sondern mehrere Sensorknoten zusammen als Gruppe bewegt und können gemeinsam lokalisiert werden. Das ist z.B. der Fall, wenn mehrere Fertigungsteile gemeinsam zum selben Bestimmungspunkt befördert werden. Die Positionsschätzung dieser Sensorknoten kann durch zusätzliche Informationen der benachbarten Sensorknoten bei der Filterung verbessert werden.

In diesem Praktikumsprojekt sollen Algorithmen für die Gruppen-Lokalisierung mittels UWB innerhalb von Gebäuden entwickelt werden.

Aufgaben

- Einarbeitung in bereits existierende Filteralgorithmen für die Positionsschätzung mittels UWB,

- Implementierung eines Algorithmus zur Erkennung von Gruppenbildung mehrerer Sensorknoten,

- Implementierung einer verbesserten Lokalisierung mittels der zusätzlichen Gruppeninformation,

- Untersuchung der Leistungsfähigkeit des entwickelten Algorithmus mit realen Daten aus einem UWB-Sensornetzwerk und

- Untersuchung des Positionsfehlers des entwickelten Algorithmus mit Hilfe eines globalen Referenzsystems (z.B. der HTC-Vive).

Vorkenntnisse über Kalman Filter und Datenassoziation können von Vorteil sein.

Projekt 4

Einführung

In den letzten Jahren rücken selbst-lernende Verfahren wie Reinforcement Learning immer stärker in den Fokus der Regelungstechnik, da sie das Potential besitzen, einige Schwächen herkömmlicher Regelungskonzepte zu kompensieren. Dies gilt insbesondere im Bereich der modellfreien Regelung, da Reinforcement Learning durch Interaktion mit dem System selbständig lernt und somit nicht auf ein Modell angewiesen ist. Am ISAS wird aktuell eine innovative Roboterplattform entwickelt, die nicht nur in innovativen Projekten eingesetzt, sondern selbst mit neuartigen Konzepten entworfen werden soll. Dementsprechend soll die Folgeregelung der 2D-Trajektorie des Roboters mittels Reinforcement Learning entworfen werden.

Aufgaben

- Literaturrecherche und Einarbeitung in den aktuellen Stand der Forschung zu Reinforcement Learning für die Folgeregelung

- Konzeption und Implementierung eines Reinforcement Learning Reglers für die Folgeregelung einer mobilen Roboterplattform

- Implementierung des Reglers auf den Prozessoren der Roboterplattform (Arduino, Raspberry Pi)

- Vergleich des Entwickelten Reglers zu (bereits implementierten) herkömmlichen Regelungsverfahren (PID, Zustandsregler)

Projekt 5

Einleitung

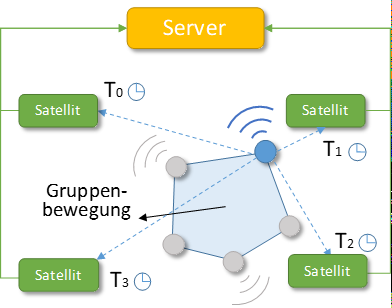

Methoden zur Lokalisierung und Navigation mittels Signalankunftszeiten werden vielfältig eingesetzt, zum Beispiel in der Luftraumüberwachung oder beim GPS. Hierbei kommen entweder elektromagnetische oder akustische Wellen zum Einsatz. In vorherigen Praktika wurde bereits ein Mikrofonarray basierend auf dem BeagleBoard-X15 gebaut. Mit einem Netzwerk von mehreren dieser Mikrofonarrays soll nun experimentell Quellenlokalisierung und -tracking durchgeführt werden. Hierbei werden auch neuartige am ISAS entwickelte Algorithmen zum Einsatz kommen.

Aufgaben

- Dokumentation der vorherigen Praktika lesen

- Linux-Kernel für X15 mit dem Audiotreiber für das Mikrofonboard kompilieren

- Netzwerk von Mikrofonarrays im ISAS-Holodeck installieren

- Referenz für die wahre Lautsprecherposition

- Ziel mit Holodeck-Roboterarm bewegen

- HTC Vive optische Lokalisierung

- Ziel soll Sounds emittieren welche optimal zur Detektion von Signalankunftszeiten geeignet sind

- Daten der Mikrofone aufzeichnen und über LAN zum PC oder Server senden

- Durchführung von Evaluationen mit den aufgezeichneten Daten unter Verwendung neuartiger Multilaterationsalgorithmen

Vorwissen über Linux und Netzwerkprogrammierung wäre vorteilhaft.

Projekt 6

Einleitung

Durch die voranschreitende robotische Automatisierung im industriellen Umfeld werden Lokalisierungsmethoden benötigt, die genaue und robuste Positionsschätzungen, z.B. in einer Fabrikhalle, liefern können. Da GPS innerhalb von Gebäuden nicht verfügbar ist, müssen alternative Technologien, die z.B. auf Ultrabreitbandtechnologie (UWB) basieren, eingesetzt werden. Doch auch Lokalisierung mittels UWB ist nicht ohne Probleme: Durch die Anwesenheit von metallischen Gegenständen in einer Fabrikhalle kann es zu einer starken Reduktion der Lokalisierungsgenauigkeit kommen. In solchen Fällen kann eine Inertialmesseinheit (IMU) verwendet werden, um die Lokalisierung über kurze Zeiträume zu unterstützen und somit den negativen Effekt der metallischen Umgebung teilweise auszugleichen. Jedoch ist dafür ein genaues Modell des UWB Messsystems und der IMU notwendig.

Aufgaben

In diesem Praktikum werden die Studenten mit einem IMU/UWB Lokalisierungssystem arbeiten, welches aus mobilen Tags die lokalisiert werden sollen und mehreren Ankern, die fest installiert sind, besteht. Während die Tags IMU Messungen bereitstellen, erzeugen die Anker UWB Messungen. Im Laufe dieses Praktikums werden die Studenten ein mathematisches Modell des IMU/UWB-Systems erstellen und ein Verfahren zu dessen Identifizierung entwickeln und implementieren. Zusätzlich sollen Algorithmen der digitalen Signalverarbeitung auf den Tags (ARM Cortex M4) bzw. auf einem Raspberry Pi implementiert werden.

- Mathematische Modellierung des IMU/UWB Messsystems

- Entwicklung und Implementierung eines Verfahrens zur Parameteridentifikation des IMU/UWB Systems

- Implementierung von Signalverarbeitungsalgorithmen auf ARM Cortex M4 und Raspberry Pi

Voraussetzungen

- Sehr gute Programmierkenntnisse in C/C++

- Optional: Erfahrung mit bare-metal Programmierung

- Gute Mathematikkenntnisse insb. Schätztheorie

- Interesse an Signalverarbeitung und eingebetteter Programmierung

Projekt 7

Einleitung

Bei sogenannten optischen Bandsortieranlagen werden Teilchen (sogenanntes Schüttgut) auf Basis visueller Eigenschaften klassifiziert. Bei der Anlage, so wie sie vom Fraunhofer IOSB lizenziert wird, werden durch richtiges Timing und gezieltes Aktivieren von Druckluftdüsen eine Klasse der Teilchen „ausgeblasen“, um so die Klassen voneinander zu trennen. Aufgrund von Verzögerungen ist es jedoch nicht möglich, die Klassifikation und das Ausblasen gleichzeitig zu vollziehen. Deshalb muss die Position der Teilchen nach ihrer Klassifikation prädiziert (vorhergesagt) werden.

Um akkurate Prädiktionen zu ermöglichen, haben wir kürzlich vorgeschlagen, die Teilchen auf dem Band mit einer Flächenkamera zu beobachten. Mittels sogenannter Multitarget-Tracking-Verfahren kann das Bewegungsverhalten aller Partikel erkannt und für die Prädiktion genutzt werden. Eine rein datenbasierte, zum überwachtem Lernen zählende Methode stellen in diesem Kontext rekurrente künstliche neuronale Netze dar.

Aufgaben

In dieser Arbeit soll ein rekurrentes Netz zum Tracking von Schüttgutpartikeln in Python/Tensorflow aufgebaut werden. Hierbei darf davon ausgegangen werden, dass die Zuordnung der Messungen zu den jeweiligen Teilchen sowie die Positionen der einzelnen Schüttgut-Teilchen bekannt ist. Ein entsprechender Datensatz mit diesen Informationen ist bereits vorhanden und kann genutzt werden. Im ersten Schritt soll nach einfachen, für diese Aufgabe passenden rekurrenten Netzwerkarchitekturen mit und ohne Long short-term memorys (LSTMs) recherchiert werden und darauf aufbauend Konzepte entwickelt sowie in Tensorflow implementiert werden. Anschließend soll der Datensatz eingeladen und die Daten für die Verwendung in den gefundenen Tensorflow-Modellen angepasst werden, sodass das Modell trainiert werden kann. Abschließend soll das Modell auf für das Training nicht benutzten Testdaten ausgewertet und die Ergebnisse gegen bereits vorhandene Ergebnisse aus anderen Tracking-Verfahren evaluiert werden.

Voraussetzungen

- Grundkenntnisse über neuronale Netze

- Optional: Grundkenntnisse in Python und Tensorflow bzw. Keras

Projekt 8

Einleitung

bitte hier klicken.

Am ISAS wird zurzeit ein mobiler Roboter entworfen, welcher über vier unabhängig angetriebene Radeinheiten verfügt, die eine omindirektionale Bewegung ermöglichen. Damit sich der Roboter zielgerichtet bewegen kann (z.B. ein bestimmten Punkt anfahren oder einem gegebenen Pfad folgen), muss er schritthaltend seine Lage (Position+Orientierung) bestimmen und ggf. Anpassen. Die dazu genutzten Algorithmen sind momentan direkt auf dem Roboter implementiert, ebenso wie die Verarbeitung der Sensordaten.

Im Rahmen dieses Praktikums soll eine alternative Lösung umgesetzt werde, in der der Roboter drahtlos über eine WLAN-Verbindung mit einem Computer kommuniziert, der die Lokalisierung und Regelung zur Pfadplanung übernimmt.

Dazu sollen verschiedene Ansätze zur netzwerkbasierten Regelung und Lokalisierung implementiert und verglichen werden. Hierbei sollen insbesondere Auswirkungen von veränderlicher Bandbreite sowie Latenzen berücksichtigt werden. Insbesondere sollen für die Lageschätzung sollen ereignisbasierte Ansätze untersucht werden.

Aufgaben

- Einarbeitung in das existierende System (Hardware und Software),

- Einrichtung einer WLAN-basierten Kommunikationsschnittstelle,

- Implementierung eines Verfahrens zur Regelung über ein Kommunikationsnetzwerk,

- Implementierung von ereignisbasierten Schätzverfahren zur Lokalisierung,

- Evaluation unter verschiedenen Netzwerkbedingungen mit einfachen Trajektorien wie Kreis oder Quadrat

Interesse an Robotik sowie Vorkenntnisse in Lokalisierungsverfahren sowie Regelungstechnik sind vorteilhaft.

Projekt 9 (wird auf Englisch gehalten!)

Einleitung

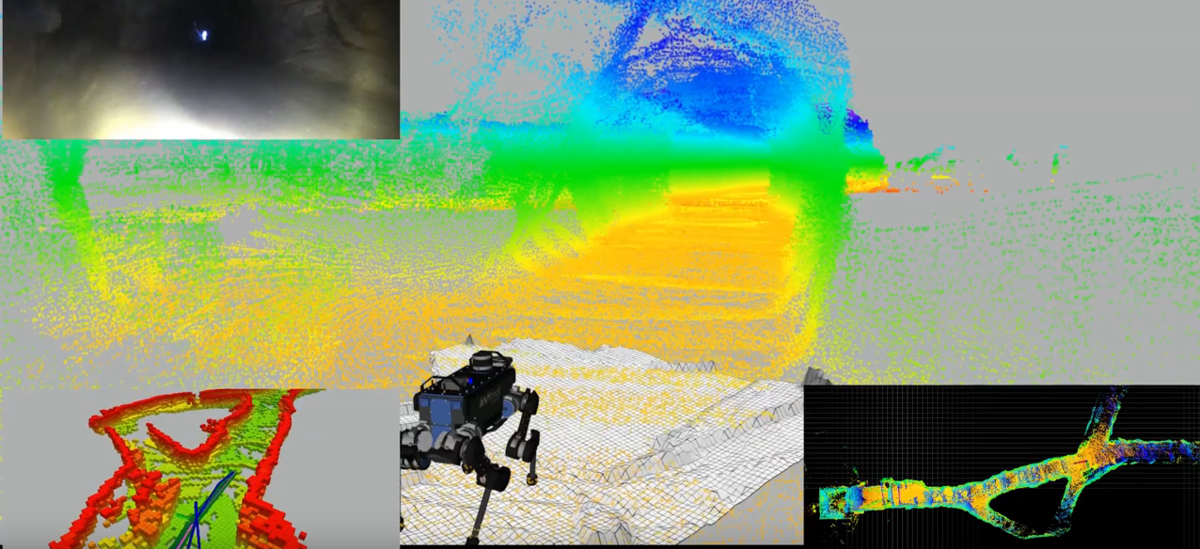

RGB-D sensors provide pixel-level color and shape perception of environments. Over the years, various 3D reconstruction systems have been developed that give good tracking and mapping accuracy as well as resolution. The underlying techniques belong to the scope of SLAM as both the ego-pose and the map is estimated at the same time. For some mobile platforms, however, existing approaches lack tracking robustness for fast motion. This can be alleviated by incorporating the inertial sensor that can provide short-term and higher-oder motion information. In this project, a robust 3D mapping system is to be prototyped based on a state-of-the-art RGB-D-IMU sensor (RealSense D435i, shown in picture). More specifically, the project is divided into following work packages:

Aufgaben

- Familiarization of an existing RGB-D dense SLAM system

- Integration of inertial readings to the tracking block in a tightly coupled manner

- Set-up of experiment platform and collection of indoor pose tracking and mapping data sets

- Evaluation based on experiments and other publicly available data sets.

ROS and C++ are prerequisite

Projekt 10 (wird auf Englisch gehalten!)

Einleitung

In many robotic applications, multiple types of sensors are needed to perform perception for complex tasks. Depending on different sensory modalities, maps are usually represented in different formats and scales. Therefore, algorithms need to be developed to fuse multi-modality maps consistently in real-time. In this project, we aim to develop a multi-modality mapping system for robotic navigation. More specifically, we define the following sub-tasks.

Aufgaben

- System integration of state-of-the-art mapping systems regarding 3D LiDAR and RGB-D camera

- Cross-sensor online calibration

- Develop algorithms for map fusion and regeneration for robotic navigation

ROS and C++ are prerequisite.

Anrechenbarkeit

Vertiefungsgebiete

-

Theoretische Grundlagen

-

Robotik und Automation

-

Anthropomatik und Kognitive Systeme

Master- und Bachelorstudiengang

Die erbrachte Leistung wird mit 8 LP angerechnet.

Seminar zum Praktikum

Optional kann im Rahmen des Praktikums zusätzlich ein Seminarschein erworben werden.

Termin und Ort

Die Einführungsveranstaltung findet am Freitag, 18.10.2019 um 14:00 Uhr in Raum 148, Gebäude 50.20 statt.

Weitere Termine:

- Projektvorstellung: Fr. 25.10.2019 14:00 Uhr in Raum 148, Gebäude 50.20

- Zwischenpräsentation: Fr. 13.12.2019 14:00 Uhr in Raum 148, Gebäude 50.20

- Endpräsentation: Fr. 07.02.2020 14:00 Uhr in Raum 148, Gebäude 50.20

Anmeldung

- Die Anmeldung erfolgt per Formular am Ende dieser Seite.

- Bei der Einführungsveranstaltung wird der Ablauf des Praktikums erläutert. Es müssen alle angemeldeten Studenten anwesend sein. Die Projekte, die nicht vergeben wurden, werden an diesem Termin nicht angemeldeten Studenten angeboten.

Koordination: